3D数字人行为 AI引擎

智能数字人自然语言对话高精度动画解决方案

AnimaCore

AnimaCore

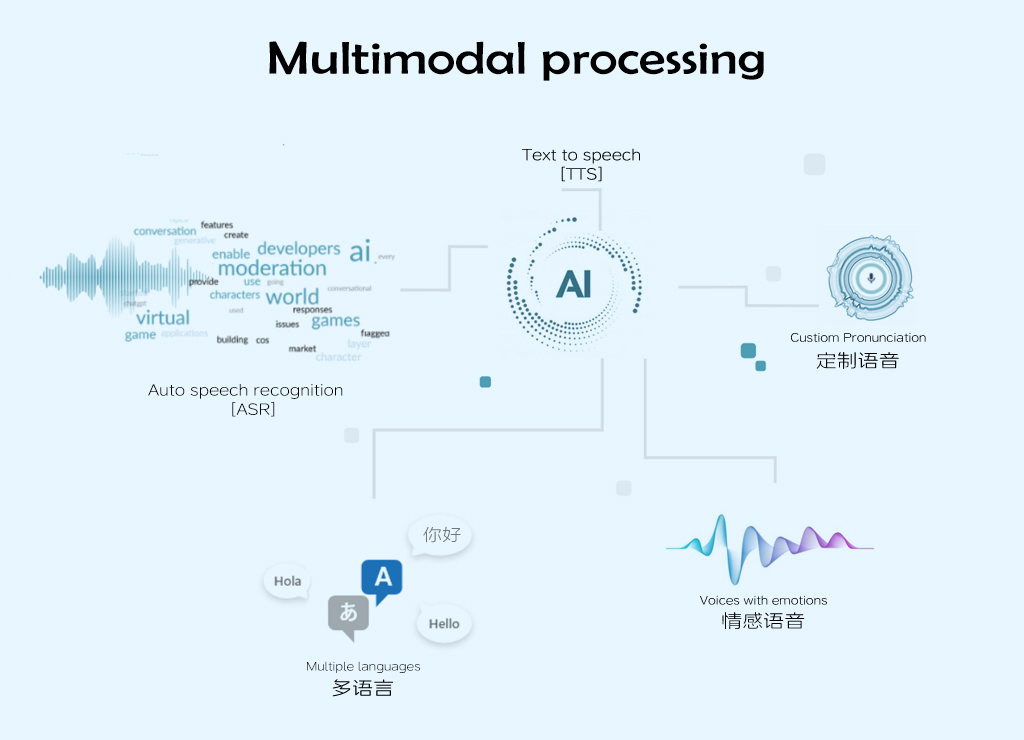

结合深度学习技术,基于Transformer架构的自注意力机制,能够实现从语音和文本到高质量口型动画的无缝转换。核心技术通过多模态学习,综合分析语音的声学特征和文本的语义信息,确保生成的口型与语音同步,并且能够适应不同的语言类型和说话方式。

- 支持私有化部署

- 支持自定义大语言模型接入

- 支持自定义语音接入

- 支持各国语言推理

- 支持动画模型定制训练

产品优势

高速动画推理

在RTX 3090 GPU标准工作环境下,针对动画生成或类似任务,平均能够在 1 秒之内完成至少50 秒的动画推理,并输出至少25秒动画数据,表现出极高的实时处理能力。

超低资源占用

模型经过轻量化与量化处理,在保持主任务高精度的前提下,显著降低内存与显存使用量。 适用绝大多数主流民用级GPU。适配不同平台(windows,linux),均可获得良好的资源利用率,不论是在高性能服务器还是通用 PC 环境中都能稳定运行。

智能分段机制

对于长文本或长音频推理场景,模型可在分段处理与缓存机制的协同作用下进一步提高整体推理效率,显著降低等待时间。

扩展性与部署

采用模块化、可插拔的设计理念:核心推理与预处理、后处理部分均能相对独立地开发与维护。分布式训练与推理框架能够处理海量数据,随时扩容以适应不断增长的业务需求。便于集成到现有生产环境或快速搭建新应用场景。

稳定性与精度

在多种数据分布及复杂场景下进行测试和验证,通过误差检测与鲁棒性测试确保结果稳定可靠。持续监控并定期更新模型参数,及时发现与修复异常,使系统在长时间运行后仍然保持良好精度。

便捷定制性

可根据实际业务需求灵活调整模型结构或推理流程,以平衡不同任务对速度与准确度的要求。

易维护:完善的日志监控、告警与自动化部署体系,可有效减少运维成本并保证快速迭代。

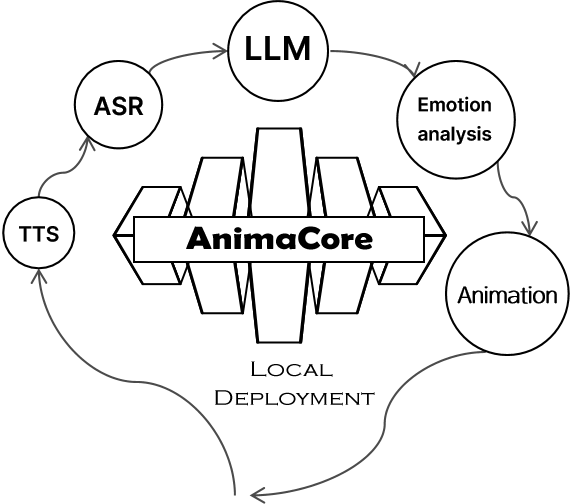

商业部署

AnimaCore

项目部署支持

私有化部署,模块化管理,支持TTS、ASR、LLM自由更换,支持多客户端推理,满足中、大型商业项目使用需求,动画推理低至毫秒级响应。

- 本地部署

- 云端部署

- 无限推理时长

- 专项技术支持

- 定制AI模型训练